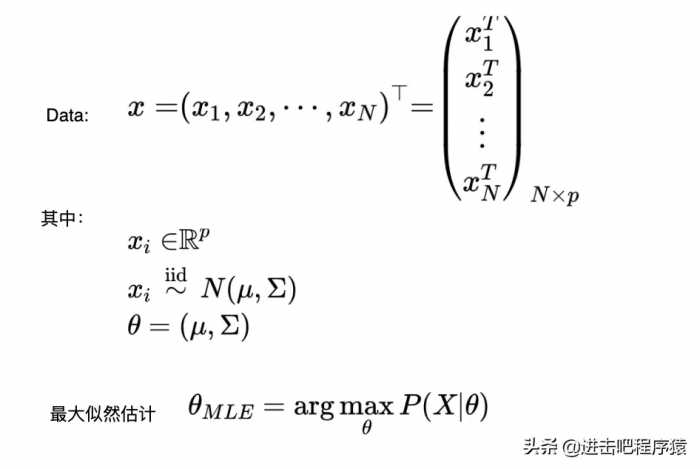

假设我们有数据N个样本,每个样本都是一个p维数据,

此处xi是p维,每个x都是独立同分布的,服从高纬的高斯分布。

我们假设参数θ 是固定的,那我们就可以通过最大似然估计来求 θ

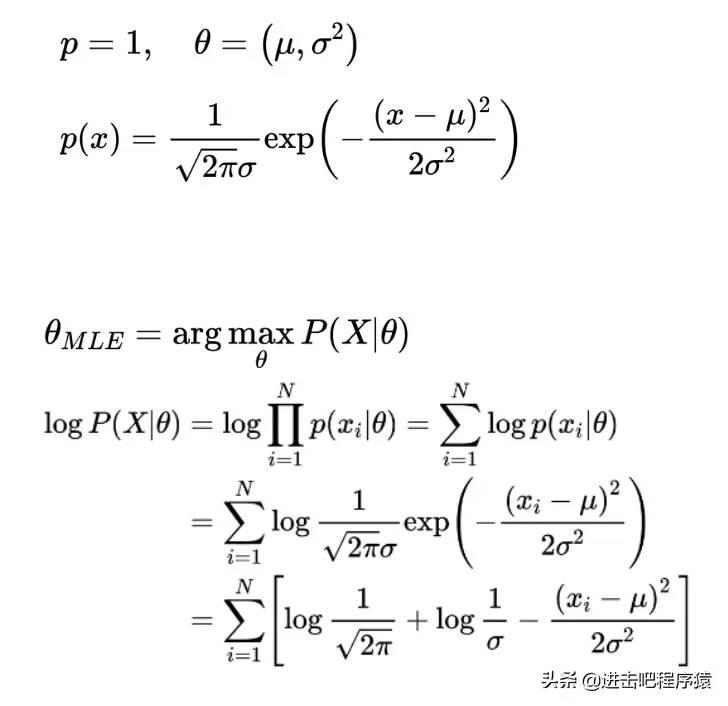

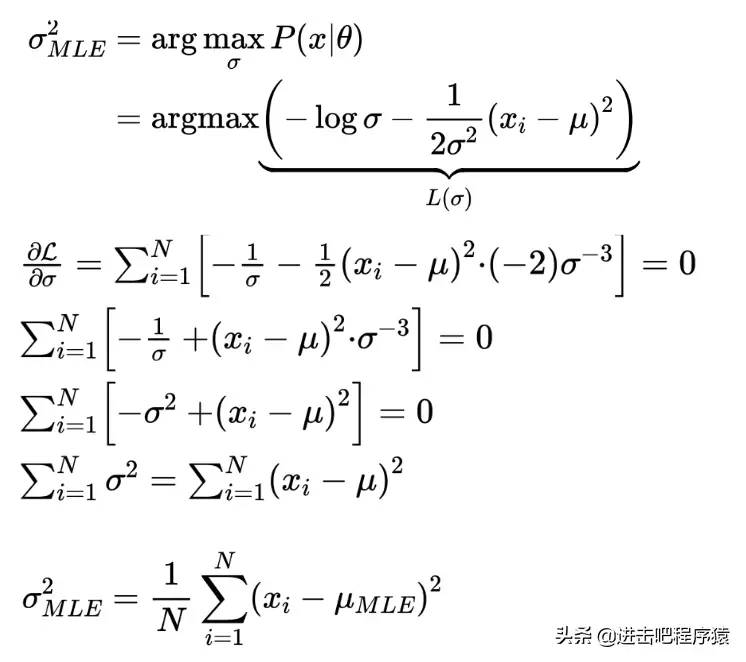

先来看最简单的情形,每个数据都是一维:

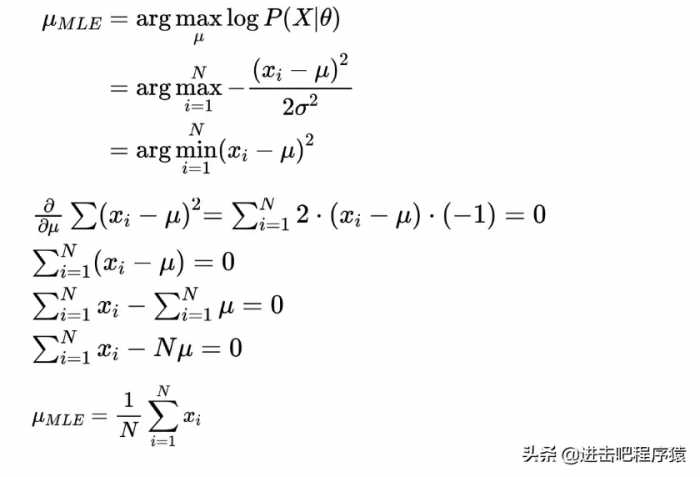

分别求两个参数的极值

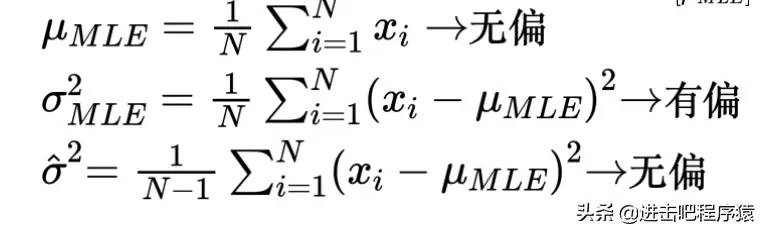

下面解释两个非常重要的概念:有偏估计和无偏估计。

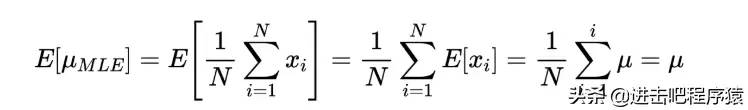

我们预估样本的均值就是总体的均值

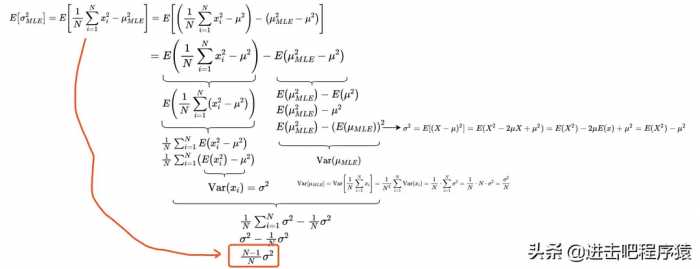

样本的方差比真实的误差小了。

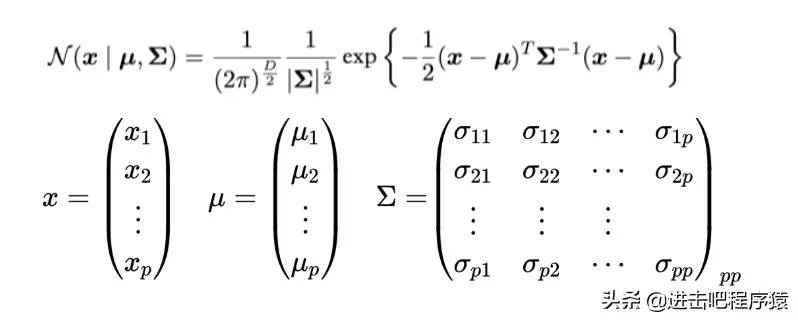

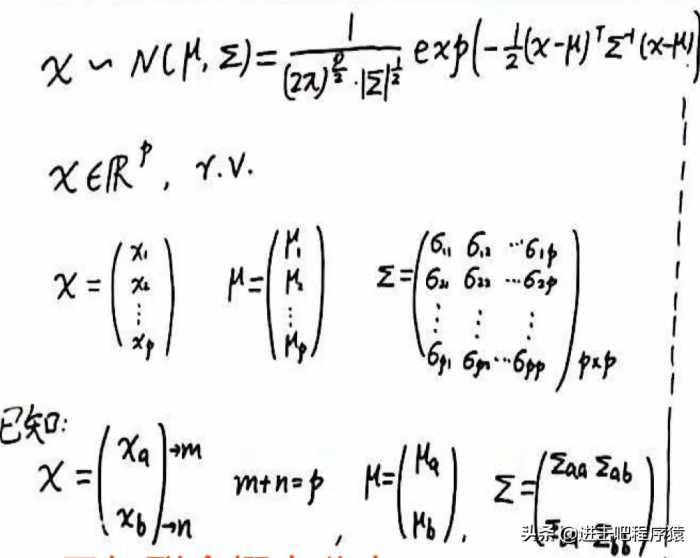

下面我们来看高维分布:

其中 Σ 是正定,或半正定矩阵【浅谈正定矩阵和半正定矩阵】

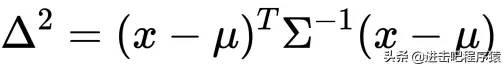

称为马氏距离,具体的含义如下:

我们来看当p=2维,协方差矩阵为单位矩阵

则马氏距离就是欧式距离,下面来具体看马氏距离的含义:

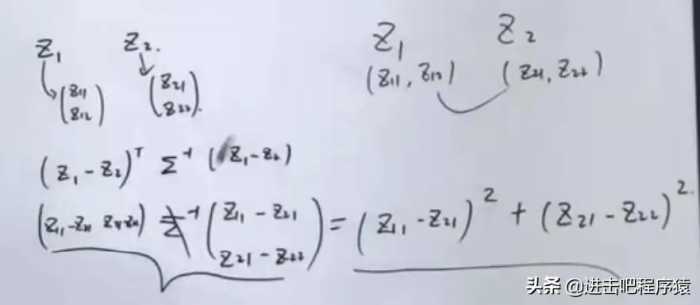

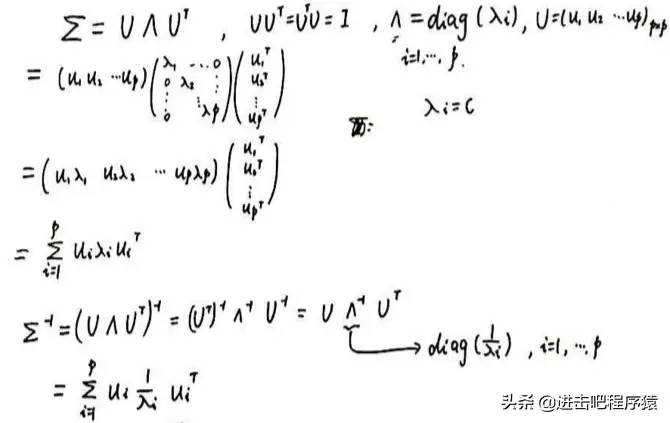

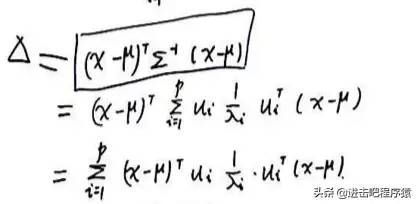

因为 Σ 是正定矩阵,我们可以将其分解为如下形式:

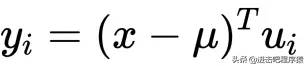

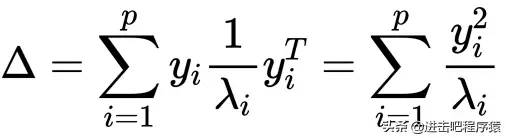

接着我们定义,

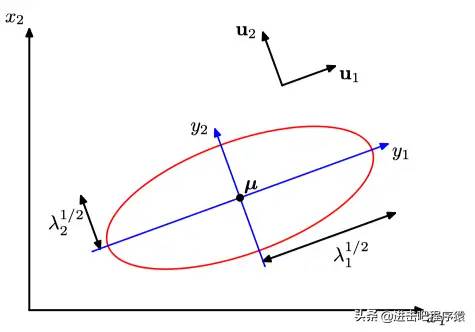

物理含义:x向量在ui方向上的投影,于是有:

我们以二维空间来解释上面的式子的含义:

我们知道 p(x) ~ N(u, Σ) 的高斯分布,p(x)在0-1之间,那对于不同的p(x) 的取值,我们都会算出一个对应的 ∆ ,那就是对应了一个不同的椭圆大小。

下面说下高斯分布的几个限制:

- 随着xi维数的升高,协方差矩阵参数个数以平方增多

- 解决方法,简化协方差矩阵,变为对角阵 更进一步,对角阵上特征都相等【各向同性】

- 高斯函数是一个单峰分布,不能很好的拟合多峰分布

- 引入隐变量

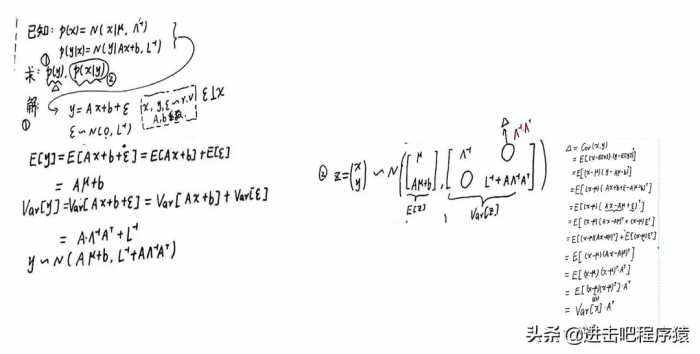

最后再聊介绍下条件高斯分布

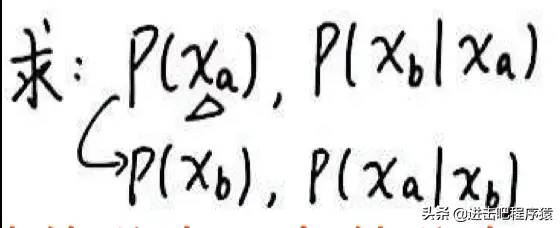

求边缘概率和条件概率

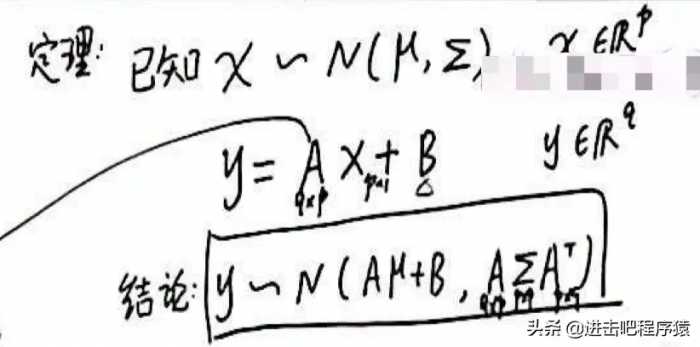

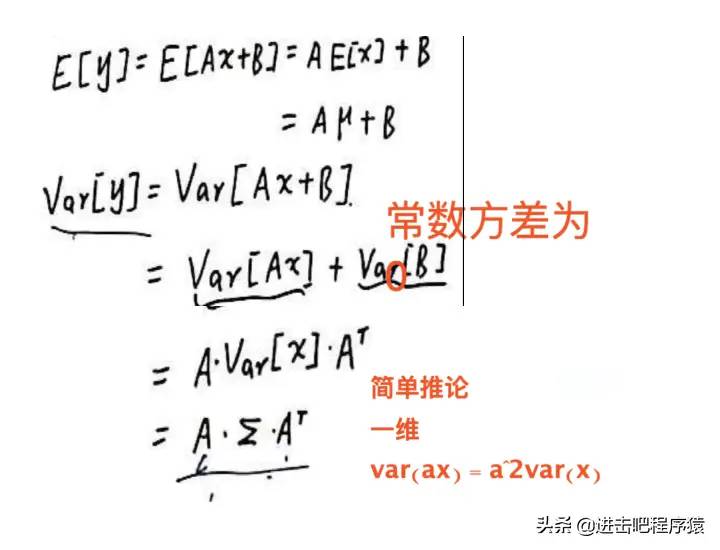

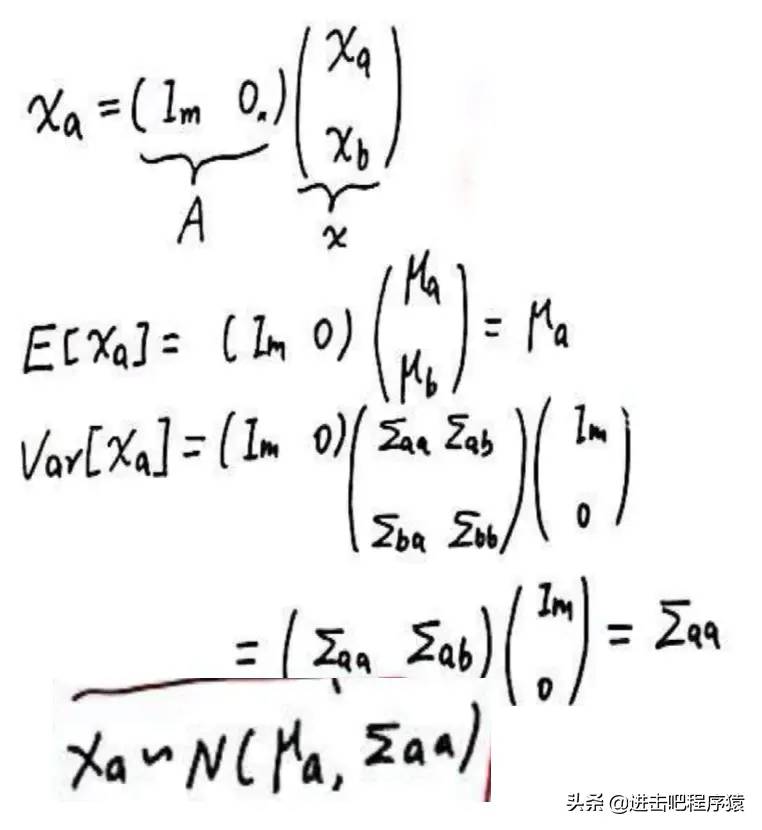

先说一个定理:

此处 x 是p维,A 是 qxp 矩阵,B是q维,则y是一个q维矩阵,且服从高斯分布。

有了这个定理有:

边缘分布:

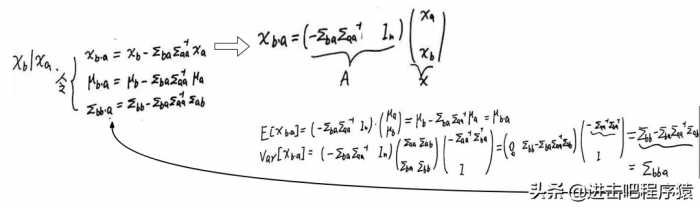

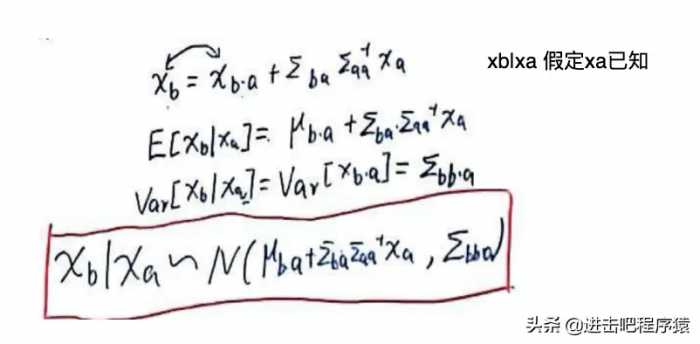

条件分布:

最后条件分布:

下面我们再来求:已知边缘概率和条件分布,如何求联合分布。